8月30日消息,阿里通义千问发布第二代视觉语言模型Qwen2-VL。其中,旗舰模型Qwen2-VL-72B的API已上线阿里云百炼平台。

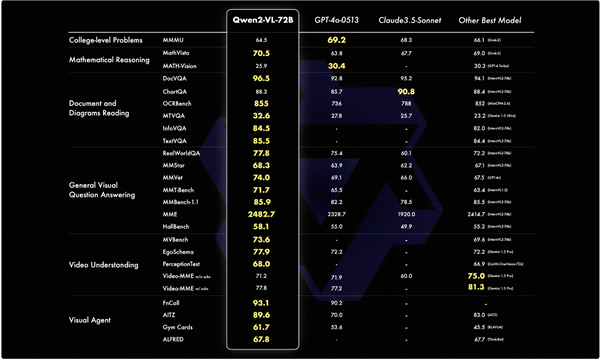

据了解,Qwen2-VL在多个权威测评中刷新了多模态模型的最佳成绩,在部分指标上甚至超越了GPT-4o和Claude3.5-Sonnet等闭源模型。

2023年8月,通义千问开源第一代视觉语言理解模型Qwen-VL,成为开源社区最受欢迎的多模态模型之一。

短短一年内,模型下载量突破1000万次。目前,多模态模型在手机、车端等各类视觉识别场景的落地正在加速,开发者和应用企业也格外关注Qwen-VL的升级迭代。

相比上代模型,Qwen2-VL的基础性能全面提升。可以读懂不同分辨率和不同长宽比的图片,在MathVista、DocVQA、RealWorldQA、MTVQA等基准测试创下全球领先的表现。

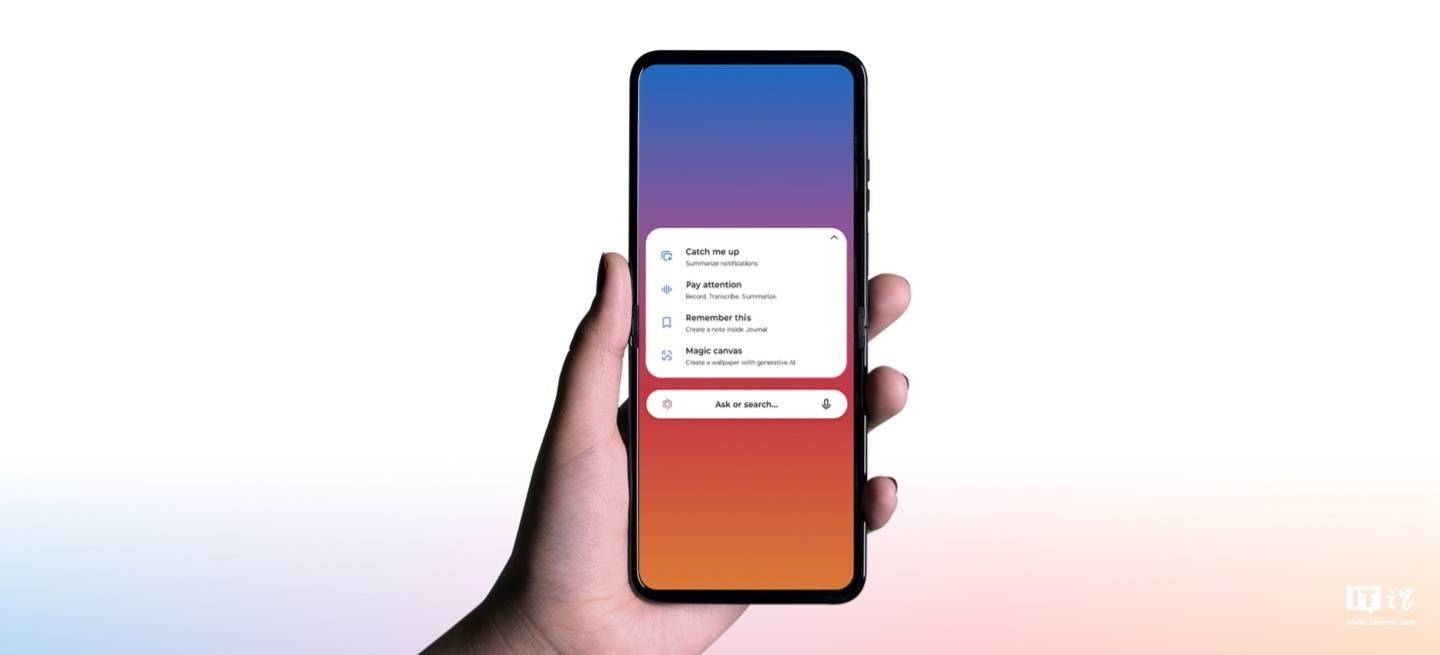

此外,Qwen2-VL可以理解20分钟以上长视频,支持基于视频的问答、对话和内容创作等应用。同时,具备强大的视觉智能体能力,可自主操作手机和机器人,借助复杂推理和决策的能力,Qwen2-VL可以集成到手机、机器人等设备,根据视觉环境和文字指令进行自动操作。

该模型还能理解图像视频中的多语言文本,包括中文、英文,大多数欧洲语言,日语、韩语、阿拉伯语、越南语等。

通义千问团队从六个方面评估了模型能力,包括综合的大学题目、数学能力、文档表格多语言文字图像的理解、通用场景问答、视频理解、Agent 能力。

Qwen2-VL-72B 在大部分的指标上都达到了最优,甚至超过了 GPT-4o 和 Claude3.5-Sonnet 等闭源模型,在文档理解方面优势尤其明显,仅在综合的大学题目方面与GPT-4o 存在差距。

用户可通过阿里云百炼平台调用Qwen2-VL-72B的API:https://help.aliyun.com/zh/model-studio/developer-reference/qwen-vl-api

京公网安备 11011402013531号

京公网安备 11011402013531号