图片系AI生成

当更多目光聚焦于AI算力时,国内通用算力市场的竞争也悄然进入到了白热化阶段。

2020年8月,国务院印发了《新时期促进集成电路产业和软件产业高质量发展的若干政策》。该政策强调,集成电路产业和软件产业是信息产业的核心,是引领新一轮科技革命和产业变革的关键力量。另有消息显示,中国芯片自给率要在2025年达到70%左右。

2025年,外部围堵封禁的大环境不会变化,甚至有愈演愈烈的趋势,国内通用计算厂商经过几年发展,在产品层面达到了成熟“可用”的级别,而从“可用”到“好用”,将是下一阶段的主线逻辑。

国内CPU厂商的角逐焦点,正从单一性能指标转向生态体系的构建——谁能以更完整的软硬件协同能力、更低的用户迁移成本、更广泛的应用场景适配性赢得市场,谁就能在未来的算力话语权争夺中占据先机。

通用计算生态多种路线,ARM正当时

国产CPU已形成多条路线发展的模式,包括x86技术授权路线的海光信息和兆芯,ARM 指令集授权路线的鲲鹏和飞腾,RISC-V指令集路线的微芯、中科院计算技术研究所,以及自研指令集路线的龙芯和申威等。

其中,x86技术路线性能高,生态兼容x86架构;ARM架构技术路线具备指令集精简、功耗低、性能高的特点;RISC-V是一个围绕极简指令集的开源架构体系,具备架构简单、模块化设计、可扩展、自由定制等突出特点;自研指令集路线的自主设计程度较高,正在从专用市场向公开市场扩张。

不同技术路线的发展各有特点,是不同厂商各自权衡和选择的结果,其中ARM架构的开放性更加生态友好。以授权为例,ARM本身和x86架构不太一样,它不生产芯片,只做IP的授权,包括指令集的授权、硬核/软核授权等。

指令集的授权比较彻底,类似于给了一块地皮,上面可以盖毛坯房,也可以盖商品房,也可以盖别墅。硬核授权就是类似于我给你一个精装房,里边只能买买家居,买买画,改动的空间比较小。从这个角度来讲,国内来看,鲲鹏和飞腾都是彻底的指令集的授权,指令上可以进行演进,能够做到持续演进

行业观点多认为,ARM会是未来通用计算的主流选择。因为X86本身受限于封闭,包括架构的一些短板,ARM是通用算力未来的趋势和主流选择。国外在没有技术限制的情况下,谷歌。微软都在推出自己的ARM产品,AWS尤其突出,截止到2024年Q1,单季度自用的ARM算力达到60%。

国内鲲鹏系服务器占比超20%

今年两会期间,国产算力再度受到广泛关注,科大讯飞董事长刘庆峰强调构建自主可控的国产算力平台生态,小米创始人雷军、京东高级副总裁曹鹏等也纷纷提出了加强自主创新、建设异构算力基础设施等提案。

信息化改造和替换已经进入深水区,政企客户不只关注短期的性能指标,更关注长期的演进路线。以鲲鹏为例,注重从“硬”到“软”构筑整个计算产业链条,包括采用国内的产业链,从处理器设计、制造到封装,在芯片基础上构筑了网卡/RAID卡/SSD/DPU的全链条,实现服务器完全的自主创新。

国产化自主创新不代表落后,开放的计算生态是追赶先进的必经之路,目前鲲鹏把主板开放给合作伙伴,在软件生态层面,数据库openGauss、操作系统openEuler等,构建了开放开源的生态,当前6000+合作伙伴的17000+行业解决方案已支持和适配鲲鹏。。

在迁移改造方面需要强调的是,迁移不是一个软件应用的迁移,而是包括硬件、操作系统、数据库等端到端的系统工程,目前部分厂商的应用迁移依赖于ISV合作伙伴,可能存在迁移不彻底的问题,后续可能还会涉及二次国产化改造。

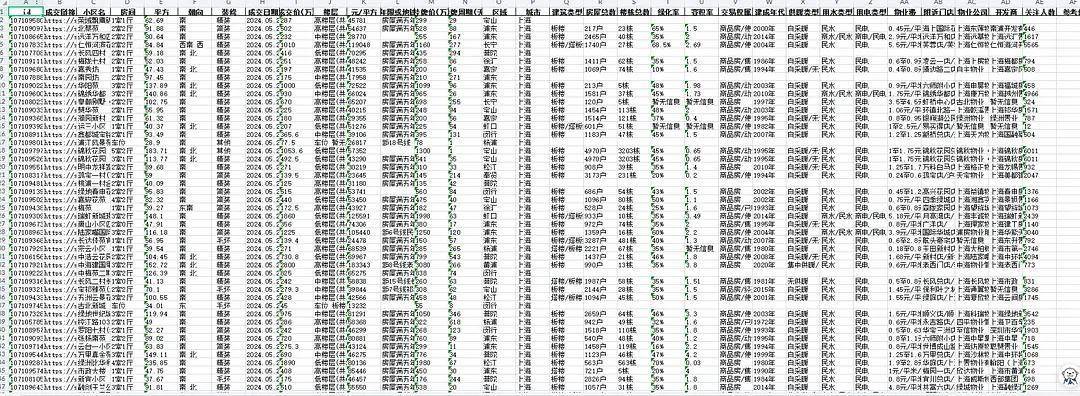

根据2024年IDC中国区服务器报告显示,鲲鹏系服务器中国区市场份额占比达20%以上。当前鲲鹏在金融、运营商、政府、互联网的一些核心场景都有覆盖,比如金融的分布式的数据库场景、证券低时延交易、运营商的核心网等。

在异构计算方面,AI计算依然需要CPU做中枢大脑,协调其他的算力任务,鲲鹏作为开放通用算力底座,基于鲲鹏的整机服务器可以兼容各种类型的XPU算力做推理。

很多企业客户也在思考,DeepSeek开源之后带来的推理场景的爆发,但是轻量级的推理任务是不是需要昂贵的AI算力,比如NPU或者GPU的推理服务器,CPU某些程度也能够解决一部分问题。未来通用算力和智能算力一定是融合、螺旋向前发展的态势,更多要取决于客户的投资以及应用场景。(本文首发于,作者 | 张帅,编辑 | 盖虹达)

京公网安备 11011402013531号

京公网安备 11011402013531号