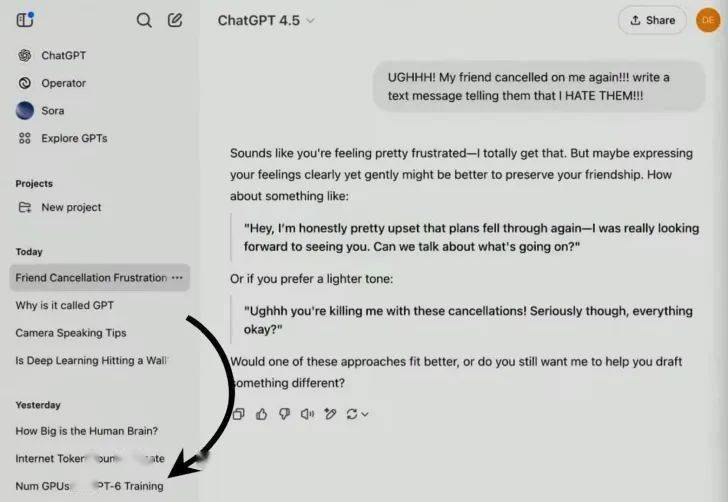

3 月 1 日消息,科技媒体 smartprix 昨日(2 月 28 日)发布博文,报道称 OpenAI 在介绍 GPT-4.5 模型的视频中,意外泄露了 GPT-6 训练可能需要的 GPU 数量,暗示其规模将远超以往。

注:在 GPT-4.5 模型介绍视频的 2 分 26 秒处,OpenAI 展示 GPT 4.5 功能的聊天记录中,出现了“Num GPUs for GPT 6 Training”(训练 GPT-6 所需的 GPU 数量)的字样。

虽然视频中未对此进行任何解释,但“Num”可能暗示了一个前所未有的数字,该媒体推测高达 10 万块 GPU。

此前有消息称,OpenAI 在训练 GPT-3 时使用了约 1 万块 GPU,而随着模型的不断迭代,对计算资源的需求也在不断增加。

内部代号为“Orion”的 GPT 4.5 在自然度和减少“幻觉”方面取得了重大进展,其参数量可能超过 3 到 4 万亿。据推测,GPT 4.5 的训练使用了 3 万到 5 万块 NVIDIA H100 GPU,训练成本约 7.5 亿到 15 亿美元(备注:当前约 54.69 亿到 109.37 亿元人民币)。

截图中“Num”的含义尚不明确,它可能代表“Numerous”(大量),暗示 GPT-6 的训练规模远超以往。当然,这也有可能只是 OpenAI 的一个烟雾弹,就像之前用“Strawberry”(草莓)作为 o1 系列的代号一样。

京公网安备 11011402013531号

京公网安备 11011402013531号