2月25日晚间,阿里巴巴宣布,阿里云视频生成大模型万相2.1(Wan)开源。此次开源采用Apache2.0协议,14B和1.3B两个参数规格的全部推理代码和权重全部开源,同时支持文生视频和图生视频任务,全球开发者可在Github、HuggingFace、魔搭社区下载体验。

通义万相是阿里云通义系列AI绘画创作大模型,可辅助人类进行图片创作,于2023年7月7日正式上线。今年1月初,通义万相视频生成模型宣布升级至2.1版,凭借着优秀的表现,在权威评测榜单VBench中登上榜首。

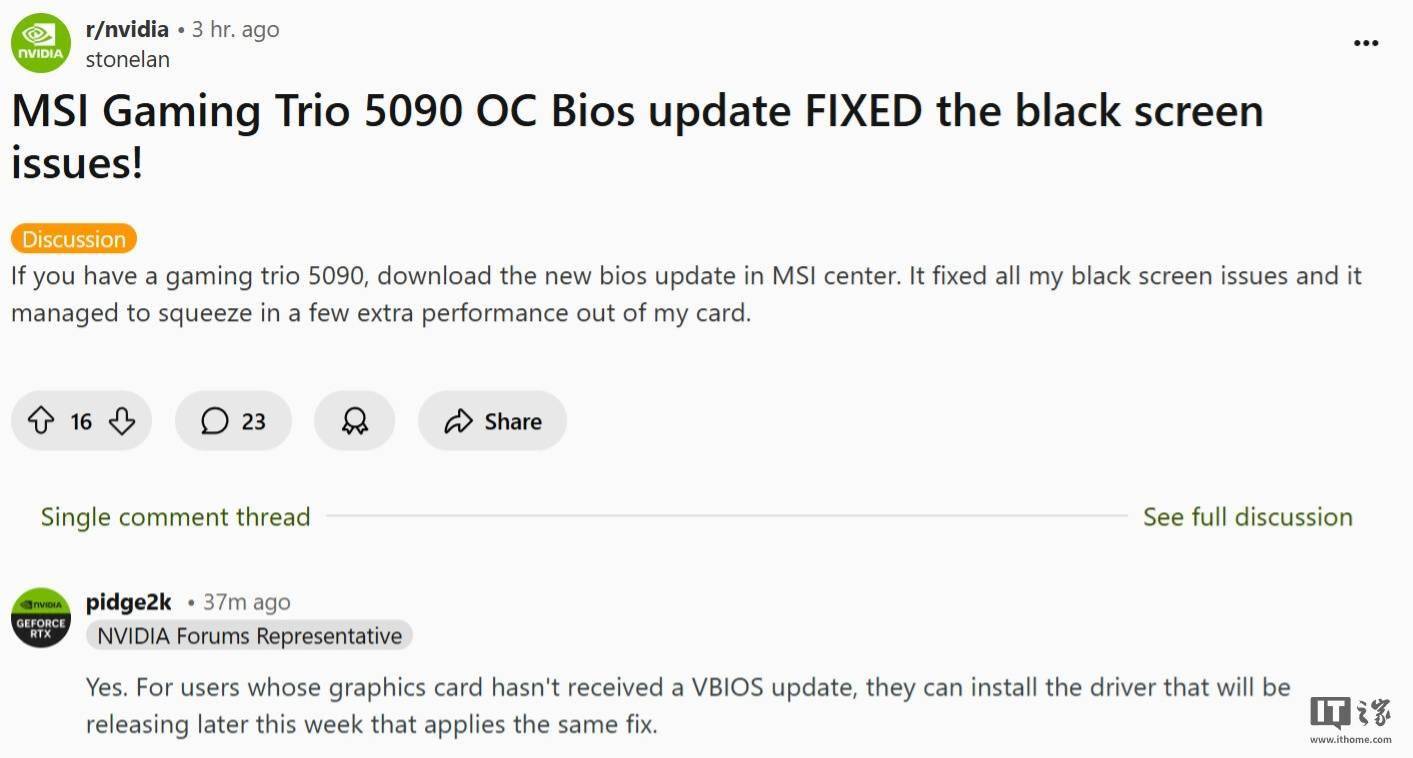

微信公众号“阿里云”截图

公开资料显示,此次开源共包括两个参数版本模型。

其中14B版本万相模型,在指令遵循、复杂运动生成、物理建模、文字视频生成等方面表现突出,在权威评测集Vbench中,万相2.1以总分86.22%大幅超越Sora、Luma、Pika等国内外模型,稳居榜首位置;1.3B版本万相模型,超过了更大尺寸的开源模型,还和一些闭源的模型结果接近,同时能在消费级显卡运行,仅需8.2GB显存就可以生成480P视频,适用于二次模型开发和学术研究。

演示材料显示,万相大模型在多个内部和外部基准测试中,均大幅超越现有的开源模型以及顶尖商业闭源模型。万相能够稳定展现各种复杂的人物肢体运动,如旋转、跳跃、转身、翻滚等;能够精准还原碰撞、反弹、切割等复杂真实物理场景。在指令遵循能力方面,能够准确理解中英文长文本指令,还原各种场景切换、角色互动。(观察者网)

京公网安备 11011402013531号

京公网安备 11011402013531号