2月24、25日,DeepSeek先后宣布开源了FlashMLA代码,以及DeepEP通信库,誓将大模型开源化进行到底。

DeepSeek-R1模型的问世与开源,让苦于算力瓶颈的大模型行业看见了曙光,与其他大厂不同的是,DeepSeek在追求算力叠加之外,另辟蹊径,选择了一条不同寻常的路径—算法,通过算法的创新和优化,解决了困扰大模型行业的算力“焦虑”的问题。

另一方面,受到DeepSeek的影响,也打破了国内原有算力产业的格局,AI服务器出货不断激增,同时能承接DeepSeek大模型相关应用的一体机爆火,各大厂商纷纷布局,呈现出“百舸争鸣”的趋势。

开源仍在继续

自DeepSeek-R1 671B模型宣布开源已经过去1个月,就当人们认为DeepSeek的开源热潮已告一段落之际,2月21日DeepSeek宣布启动“Open Source Week”,计划在一周内开源5个代码库。

2月24日,DeepSeek宣布开源FlashMLA代码。FlashMLA是DeepSeek开源的MoE(Mixture of Experts)训练加速框架,其核心创新在于通过低秩矩阵压缩KV缓存,显著减少内存占用与计算开销,,支持千亿参数模型的高效训练。浪潮信息相关负责人表示,MLA算法相比于主流的MHA和GQA算法,在没有显著降低计算精度的情况下,大幅降低了推理时的KV cache占用,从而提升了推理效率。

据悉,FlashMLA专为英伟达Hopper GPU(如H800)设计,通过优化可变长度序列处理,实现了内存带宽3000 GB/s和浮点算力580 TFLOPS的极限性能,接近H800的理论峰值,也就是说,通过FlashMLA,用户可以将H800的性能做到英伟达官方给出性能的2~3倍,从而使用H800就能达到H100的性能(官方数据H100性能约为H800的2倍),在实时生成任务的效率的同时,FlashMLA还能降低部署大模型部署成本,从而进一步降低大模型应用的门槛,推动大模型在各行各业中的落地。

另一方面,FlashMLA的开源为国产GPU兼容CUDA生态提供了参考模板,对此,神州数码副总裁、CTO李刚告诉,DeepSeek的开源策略降低了开发者对封闭生态的依赖,加速RISC-V、ARM等架构的AI加速芯片发展,推动硬件生态向多厂商竞争格局转变。同时,也推动了大模型在国产GPU芯片上的规模化使用。

除此之外,北京并行科技股份有限公司AI云联创人、AI云事业部总经理赵鸿冰也曾向表示,DeepSeek的算法优化技术,提升国产芯片的性价比,加速替代进程。

紧接着,在FlashMLA代码宣告开源之后,2月25日,DeepSeek又带来了惊喜,宣布DeepEP通信库开源。

据悉,DeepEP是第一个用于MoE模型训练和推理的开源EP通信库,该库还支持低精度运算,包括FP8格式。MoE架构需要多专家模型协同工作,这之间产生了高通信成本,而DeepEP通过优化All-to-All通信、支持NVlink/RDMA协议,实现节点内外的高效数据传输,降低训练与推理的延迟。并且,通过灵活的GPU资源调度,DeepEP在通信过程中并行执行计算任务,显著提升整体效率,尤其适用于大规模分布式训练。

DeepEP的优化思路就好比:在生产环节,运输原材料和加工的环节同时进行,而不是等所有材料运输完毕再开始加工。GPU在通信的同时进行计算,从而减少等待时间,保持硬件的高利用率,避免空闲。

算法打破算力瓶颈

在DeepSeek开源之前,整个2024年,大模型行业都陷入了算力焦虑之中。大模型训练、推理带来的高昂的算力成本,让许多企业望而却步,同时,算力的瓶颈也带来了商业化的焦虑,也让很多玩家退出了市场的竞争。

但随着DeepSeek-R1模型的问世和开源,重新点燃了市场的热情。除了在EP通信库和FlashMLA的优化以外,DeepSeek还在算法的多个方面进行了创新和优化,打破了长久以来大模型算力的瓶颈。

比如DeepSeek通过混合专家架构(MoE)与FP8训练技术优化计算效率,显著减少模型对高算力硬件的依赖。R1模型仅需2048块GPU即可完成训练,纯算力训练成本降至500多万美元,远低于传统大模型的数亿美元投入。这一突破推动硬件行业向高能效、低成本方向转型。

具体来看,DeepSeek在MoE架构方面的创新包括了,使用共享专家和路由专家两种专家。其中,共享专家用于学习公共知识,路由专家学习专用知识,提升了模型的训练效率。其次,DeepSeek的MoE模型和业界其他的MoE模型相比稀疏度更高,也对节省训练和推理的算力大有帮助。

另一方面,赵鸿冰告诉,DeepSeek通过对计算精度的调整,采用低精度代替高精度运算,大幅减少内存需求,同时通过量化技术维持模型性能,使模型能够在消费级GPU上运行。

除此之外,DeepSeek摒弃了传统的监督学习微调(SFT),采用纯强化学习策略(GRPO)直接优化推理能力。群体奖励优化技术,通过对比不同策略组的得分(如准确性、逻辑严谨性)动态调整模型输出,而非依赖人工标注的参考答案。通过纯强化学习直接提升了推理能力。

浪潮信息相关负责人特别强调道,DeepSeek R1第一次系统的论证了随着强化学习的算力投入,大模型解决复杂问题的输出长度(思考使用的token数)持续增加,解决复杂问题的能力也持续提升。

DeepSeek在算法方面的革新从长期看来,将推动算力需求的结构性增长,低成本模型加速AI应用普及,推理算力需求将呈指数级增长。

千亿美元市场,格局重塑

对于DeepSeek在算法架构方面的革新,业内多位专家给出了一致的总结性看法,李刚告诉,DeepSeek在算法架构方面的创新本质上是从“暴力堆参数”到“智能优化”的范式转变。“其技术突破不仅体现在性能指标上,更通过效率与成本的平衡,推动了AI技术的普惠化,”李刚如是说。

无独有偶,赵鸿冰也表示,总体而言,算力行业正从“规模驱动”转向“效率驱动”,技术门槛降低将吸引更多参与者,形成多元化竞争格局。

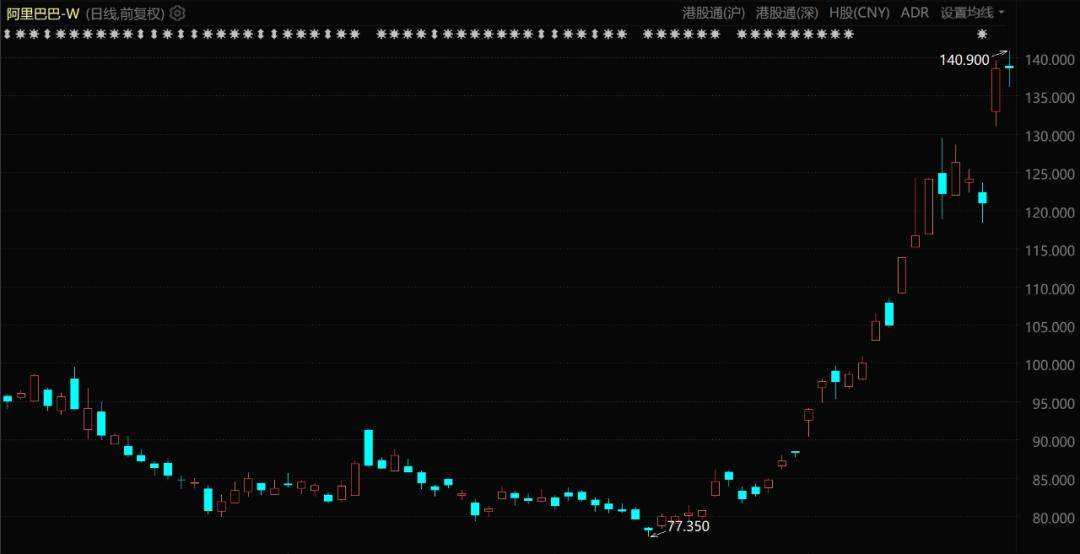

据IDC数据显示,2024年全球人工智能服务器市场规模为1251亿美元,2025年将增至1587亿美元,2028年有望达到2227亿美元,其中生成式人工智能服务器占比将从2025年的29.6%提升至2028年的37.7%。

聚焦中国算力市场,IDC数据显示,2025年,中国智能算力规模将达到1037.3EFLOPS,预计2028年将达到2781.9EFLOPS;中国通用算力规模将达到85.8EFLOPS,预计2028年将达到140.1EFLOPS,对此,IDC中国副总裁周震刚告诉,从增加趋势上分析,2023-2028年,中国智能算力五年年复合增长率预计将达到46.2%,通用算力预计将达到18.8%,“从数据上不难看出,目前,用户对于算力的需求,绝大部分的增量将产生在智能算力方面。”周震刚强调。

目前DeepSeek已经形成了“鲶鱼效应”,必将带动算力,尤其是人工智能算力市场的变革和发展。其中,在算力需求层面的改变最为明显。

在算力需求层面,DeepSeek的出现,让原本就蓄势待发的推理算力市场需求激增,“训练端需求因算法优化而相对减少,但推理端需求持续增长,导致芯片的采购重心从训练向推理倾斜。”赵鸿冰强调。

除此之外,DeepSeek的出现,降低了大模型的应用开发成本,让更多中小用户能够接触到这项技术,“一些客户之前因为缺乏技术能力和资金,无法应用大模型技术,但现在通过单机部署的解决方案使得他们能够以较低的成本和更简单的部署方式使用大模型。”浪潮信息相关负责人表示,“随着需求的下沉,算力市场的整体规模将进一步扩大。”

以点看面,从服务器市场角度出发,仅仅一个月的时间内,DeepSeek已经给服务器市场带来了翻天覆地的变动。

IDC与浪潮信息联合发布《2025年中国人工智能计算力发展评估报告》中显示,边缘计算将在更广泛的IT战略中发挥关键作用。人工智能将逐步向边缘侧或端侧倾斜,未来企业级大模型有可能将越做越小,成为可搭载于边缘侧的计算设备,从而促进大模型在各种边缘场景下发挥更大的价值。IDC研究显示,生成式人工智能正迅速成为企业在边缘计算环境中最广泛应用的工作负载。

这种变化也对单机算力提出了更高的要求,浪潮信息相关负责人告诉,目前,企业对于单机算力的需求与日俱增,“中小客户通常缺乏专业的技术团队和部署经验,因此他们对服务器的易用性和部署简便性提出了更高要求。”该名负责人指出。

从需求角度出发总结来看,用户希望服务器能够提供“开箱即用”的解决方案,减少部署时间和技术门槛。

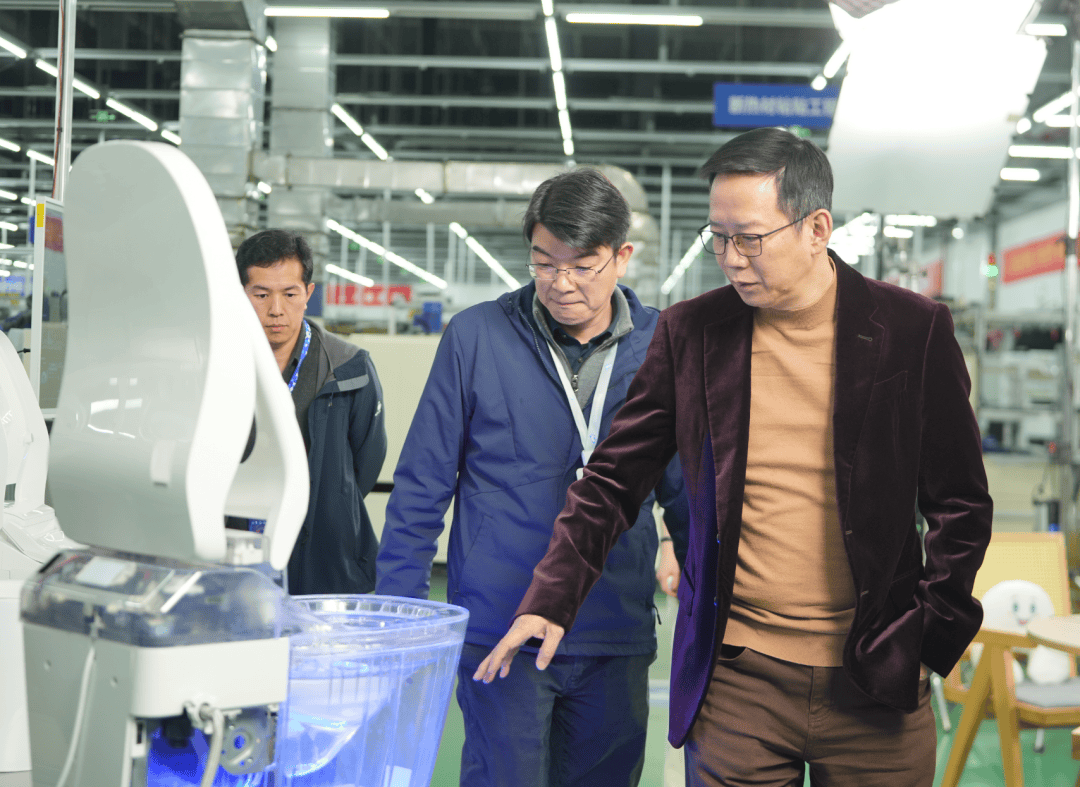

“DeepSeek推动了算力基础设施的发展。浪潮信息推出的元脑服务器R1推理系列,单机能够支持满血版的DeepSeek R1 671B模型,询价量和订单量近来都有明显上浮,”浪潮信息相关负责人指出,“这种设备更适合中小客户的需求,同时也减少了对大规模集群部署的依赖。”

不仅是浪潮信息接住了DeepSeek带来的泼天富贵,各大厂商也都针对性推出了相关的一体机产品,可以说DeepSeek的火爆,带动了整个一体机市场的爆发。比如,联想宣布,旗下大模型训推一体AI算力平台联想问天 WA7780 G3、大模型推理AI算力平台联想问天 WA7785a G3全新升级,单机即可部署DeepSeek-R1满血版大模型(具备671B参数);浪潮云推出了满血版DeepSeekV3和R1的海若一体机;神州鲲泰推出多规格一体机,适配满血版和蒸馏版推理,并联合焱融存储推出了训推一体的解决方案;天融信推出了DeepSeek安全智算一体机;京东云推出了vGPU智算一体机;青云科技推出了基石智算DeepSeek一体机;优刻得联合国产芯片厂商,完成DeepSeek全系列开源模型的适配,提供云端到本地(如大模型一体机)的灵活部署方式.......

DeepSeek对于服务器市场的改变仅是整个算力市场的缩影,除此之外,随着企业对于DeepSeek应用的加深,算力服务市场也开始了变革,对此,赵鸿冰告诉,算力服务模式正在从传统IaaS(基础设施即服务)向MaaS(模型即服务)升级,在这个过程中,从业务场景方面来看,将会更面向行业落地,云厂商通过预置DeepSeek优化模型提供端到端解决方案,降低客户算力采购复杂度。

京公网安备 11011402013531号

京公网安备 11011402013531号