报道

编辑:编辑部

就在刚刚,Figure祭出首个人形视觉-语言-动作模型Helix。机器人学会像人一样推理,听从自然语言丝滑拿起任何物体。破纪录的是,这个AI能够首次同时操控两台机器人,让它们「共脑」合作!网友:不寒而栗。

与OpenAI分手之后,Figure自研首个模型终于交卷了!

不用ChatGPT,Figure直接把视觉-语言-动作模型(VLA)——Helix装入人形机器人大脑。

它可以让机器人感知、语言理解、学习控制,是一个端到端的通用模型。

果然,Figure的一大目标,就是发展家庭机器人。为此,其内部的AI需要像人一样推理,需要处理任何家庭用品。

「机器人若不实现能力上的飞跃,将无法进入家庭领域」

目前,Helix还主要用于Figure上半身控制,包括手腕、头、单个手指、甚至躯干,能以高速率执行复杂任务。

只需一句话,机器人便可以拿起任何物品。

还有生活中各种小物件,比如金属链、帽子、玩具等等,它皆精准「拿捏」。

快看,它还会将物品放置在冰箱,而且是两个Figure协作完成。

这是因为Helix是首个同时操控两台机器人的VLA,使他它们能够解决共同的、长序列操作任务,即使是处理从未见过的物品。

有网友表示,这一刻让我瞬间不寒而栗。

另有网友表示,「这非常令人印象深刻」,甚至有人马上想要买两台体验一下。

左右

值得一提的是,新款模型采用单一神经网络权重学习所有行为,无需任何特定的微调。

而且,它还是首款完全在嵌入式低功耗GPU上运行的VLA,未来商业部署,甚至走入家庭近在咫尺。

Helix:通用视觉-语言-动作模型

家庭环境是机器人技术面临的最大挑战。

与可控的工业环境不同,家庭中充满了无数物品——易碎的玻璃器皿、褶皱的衣物、散落的玩具——每个物品都有着不可预测的形状、尺寸、颜色和质地。

要想让机器人在家庭中发挥作用,它们需要能够生成智能化的新行为来应对各种情况,特别是对于那些此前从未见过的物品。

如果没有质的飞跃,当前的机器人技术将无法适应家庭环境。

目前,仅仅教会机器人一个新行为就需要大量人力投入:要么需要博士级专家花费数小时进行手动编程,要么需要数千次示教。

考虑到家庭环境问题的庞大性,这两种方法的成本都高得难以承受。

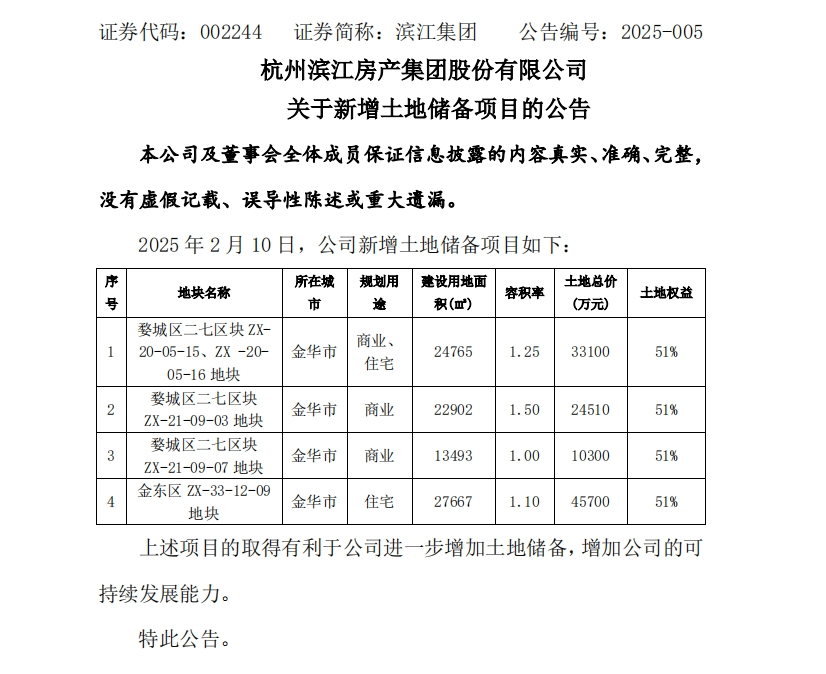

图1:不同机器人技能获取方法的扩展曲线。在传统启发式控制中,技能的增长取决于博士研究人员的手动编程。在传统机器人模仿学习中,技能随数据采集量扩展。而采用Helix技术,只需通过自然语言即可实时定义新技能

但在人工智能的其他领域已经掌握了即时泛化的能力。

如果我们能够将视觉语言模型(Vision Language Models,VLM)中捕获的丰富语义知识直接转化为机器人动作,将会带来什么改变?

这种新能力将从根本上改变机器人技术的发展轨迹(图1)。

突然间,那些曾经需要数百次示教才能掌握的新技能,现在只需通过自然语言与机器人对话就能立即获得。

关键问题在于:我们如何从VLM中提取所有这些常识知识,并将其转化为可泛化的机器人控制?Helix的构建正是为了跨越这一鸿沟。

首创「系统1,系统2」VLA

团队表示,Helix是首个由「系统1,系统2」组成的VLA,可以实现人形机器人上半身的高速精确控制。

先前的VLM主干网络具有通用性但速度不快,机器人视觉运动策略速度快但缺乏通用性。而Helix通过两个系统解决了这个难题,两个系统经过端到端训练,并可以相互通信:

系统2(S2):VLM主干网络,经互联网规模数据预训练,工作频率7-9Hz,用于场景和语言理解,可对不同的物体和场景进行泛化。

系统1(S1):80M参数交叉注意力Transformer,依靠一个全卷积的多尺度视觉主干网络进行视觉处理,该网络在模拟环境中完成预训练初始化。

这种解耦架构让每个系统都能在最佳时间尺度上运行,S2可以「慢思考」高层目标,S1通过「快思考」来实时执行和调整动作。

例如,在协作中,S1能快速适应伙伴机器人的动作变化,同时维持S2设定的语义目标。

Helix的设计相较现有方法具有以下几个关键优势:

速度和泛化能力:Helix不仅达到了专门针对单任务行为克隆(behavioral cloning)策略的运行速度,还能够对数千个全新测试对象实现零样本学习。

可扩展性:Helix能够直接输出高维动作空间的连续控制,避免了先前VLA方法中使用的复杂动作token化方案。这些方案虽然在低维控制设置(如二指夹爪)中取得了一定成功,但在高维人形机器人控制中面临扩展性挑战。

架构简单:Helix采用标准架构——系统2使用开源、开放权重的视觉语言模型,系统1则采用简单的基于Transformer的视觉运动策略。

职责分离:通过S1和S2的「解耦」,能够独立迭代优化每个系统,无需受限于寻找统一的观察空间或动作表示。

模型和训练细节

数据

研究人员收集了一个高质量的、多机器人、多操作员的多样化遥操作行为数据集,总计约500小时。

为了生成自然语言条件下的训练对,他们使用自动标注VLM来生成回顾性指令。

VLM会处理来自机器人板载摄像头的分段视频片段,提示词是这样的:「如果要实现视频中看到的动作,你会给机器人什么指令?」

为了防止数据干扰,所有训练中使用的物品都被排除在评估之外。

架构

这个系统主要包括两个主要组件,S2(VLM主干网络)和S1(基于潜层条件的视觉运动Transformer)。

S2建立在一个经过互联网规模数据预训练的7B参数开源开放权重VLM之上。它处理单目机器人图像和机器人状态信息(包括手腕姿态和手指位置),将这些信息投影到视觉-语言嵌入空间中。

结合指定期望行为的自然语言命令,S2会将所有与任务相关的语义信息提炼为单个连续潜层向量,传递给S1用于条件化其低层动作。

其中S1是一个80M参数的交叉注意力(cross-attention)编码器-解码器Transformer,负责低层控制。它依赖于一个全卷积的多尺度视觉主干网络进行视觉处理,该网络完全在模拟环境中预训练初始化。

虽然S1接收与S2相同的图像和状态输入,但它以更高的频率处理这些信息,以实现更快速的闭环控制。来自S2的潜层向量被投影到S1的token空间,并在序列维度上与S1视觉主干网络的视觉特征连接,提供任务条件。

S1以200Hz的频率输出完整的上半身人形机器人控制信号,包括期望的手腕姿态、手指弯曲和外展控制,以及躯干和头部方向目标。

另外,团队还在动作空间中,附加了一个合成的「任务完成百分比」动作,让Helix能预测自己的终止条件。这样,多个学习行为的序列化就更容易了。

训练

京公网安备 11011402013531号

京公网安备 11011402013531号