“上传照片,一键玩转AI特效,生成高级卡通脸”“我是您的AI律师,随时为您提供法律援助”“想理财找我,比如分析你的财务状况”“知道本哪吒的风火轮有多快吗”……最近一段时间,面向个人用户的大模型日渐走红,很多用户发现,在部分大模型的对话框中,出现了很多“智能体”,能提供设计头像、法律服务、理财规划,甚至与哪吒对话等功能。

可是,在获得有些服务时,用户需要上传头像、姓名、个人经历等各种隐私信息,这么做安全吗?

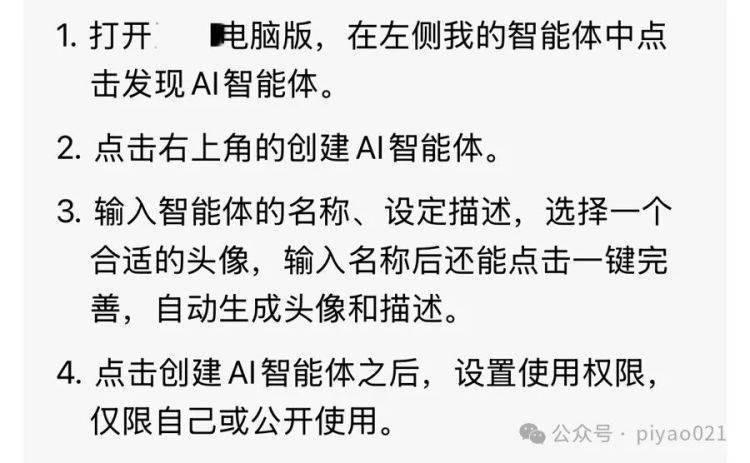

只要4步,普通人就变“智能体”?

记者调查发现,普通人几乎零门槛就能生成自己的“智能体”。

根据某大模型官方介绍,通过大模型App或网页版的相关按键,只要4步就能生成自己的“智能体”,分别是“点击(大模型对话框里的)‘发现智能体’”“创建AI智能体”“输入智能体名称、头像、描述”“设置使用权限,仅限自己或公开使用”。

某大模型提供的“创建智能体步骤”

按照以上提示,记者不到一分钟就生成了一个名叫“上海辟谣平台”的智能体;不到一分钟时间,这个智能体就通过了审核,全程没有向记者要求任何身份证明。

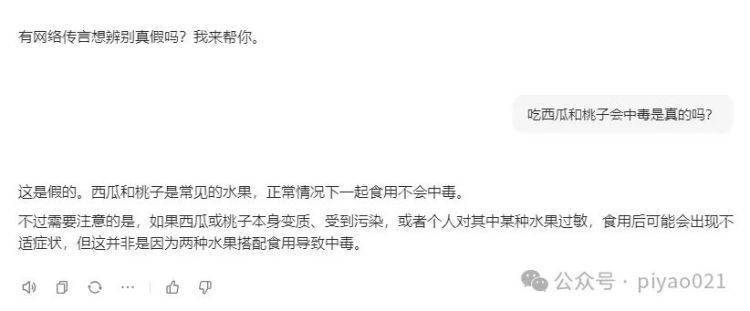

记者生成的智能体

这个新生成的智能体立刻就能公开使用。比如,向它询问网络传言,它会迅速给出答复。可是,答案既不是记者的答复,也并非来自记者提供的数据库,而是使用大模型原有的数据库。总之,记者不能干预它的答复结果。为了避免它误导他人,记者将智能体设置为不公开使用。

记者设置的智能体立刻就能用,只是答案并非记者提供

测试还发现,个人能创建不止一个智能体,不需要任何材料。

既然人人都能创建智能体,那么智能体背后的真实身份变得扑朔迷离。初步调查发现,除了部分智能体由企业设置外,很多都由个人设置,无法查证真实身份,有些还涉嫌侵权。比如在有些大模型中有很多“哪吒”,但从有限的用户信息看,很多“哪吒”与电影拍摄方没有关系。再比如,某个自称精通法律知识的“AI律师”,另一个身份是“健身与营养专家”,至于“Ta”的律师素养和健身知识是否靠谱,都没有参考依据。

这些身份都是智能体创建者自行设置的,没有任何证明材料

“智能体”安全吗?

业内人士介绍,大模型里的“智能体”更像是一种功能细分。目前,很多大模型还不支持智能体创建者自行开发新功能,或使用大模型现有数据库之外的其他数据资源;通过一个个不同的智能体,大模型的用户能更精准地找到自己所需要的服务。不过,从后续发展看,不能排除部分大模型会支持智能体创建者“自行创作”,简单来说,就是让智能体创建者在原有大模型的基础上,进行个性化的数据训练和应用开发。

这意味着,智能体创建者应当对用户的信息安全负责。可是,在现有的应用中,没有安全防护措施。用户不仅不知道智能体创建者的真实身份,也无法获悉相关智能体索取个人信息后的处理方式。

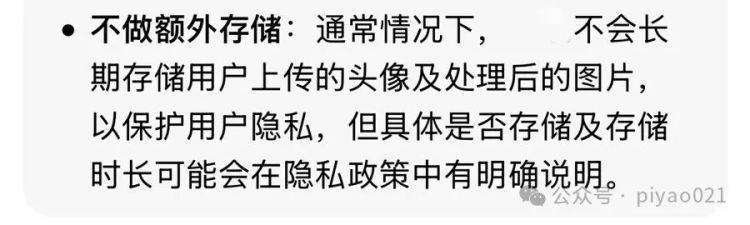

比如,记者向某个提供“AI头像生成”服务的智能体询问,它将如何处理用户上传的头像信息,仅被告知“不做额外存储,但具体是否存储及存储时长可能会在隐私政策中有明确说明”事实上,相关大模型和智能体压根就没有“隐私政策”。

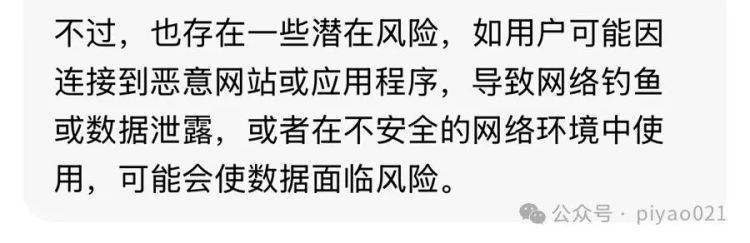

记者还将智能体的安全性话题抛给了对应的大模型,获得了一个似是而非的回答——“通常是安全的……不过,也存在一些潜在风险,如用户可能因连接到恶意网站或应用程序,导致网络钓鱼或数据泄露,或者在不安全的网络环境中使用,可能会使数据面临风险。”

大模型对智能体风险的答复

以上种种显示,按照现有的使用规则,不能排除别有用心者借助智能体索取用户隐私。

隐私保护需要提前一步

一段时间以来,各种大模型的蓬勃发展让普通人见识到了AI的力量,由此带来的安全隐患也应提前防范。

近年来,个人信息被“过度采、强制要、诱导取、违规用”的现象时有发生,多个部门已经采取措施,督促相关企业单位整改。但随着大模型的应用日渐普遍,如何防范“智能体”等线上应用违规索取个人信息的现象,需要监管部门提前一步,防范于未然。

值得一提的是,目前很多大模型不仅没有隐私政策,甚至连最基本的客户服务也没有。记者向部分大模型提问“有没有客服电话”“有没有在线客服”,得到的答复都是“没有”。比如,有的大模型表示,用户如果有问题可以通过官网或APP查看使用指南等帮助文档,或者通过APP反馈入口反映问题。

多个大模型都表示没有客服

换句话说,如果用户在使用智能体或大模型遇到问题,很可能陷入维权无门的境地。

可见,面对大模型、“智能体”等新应用,公众不要因为好奇或新鲜就放松警惕。对那些来历不明却需要提供个人信息才能使用的“智能体”,尤其要留个心眼,别把个人隐私信息拱手送上。

上海网络辟谣

京公网安备 11011402013531号

京公网安备 11011402013531号