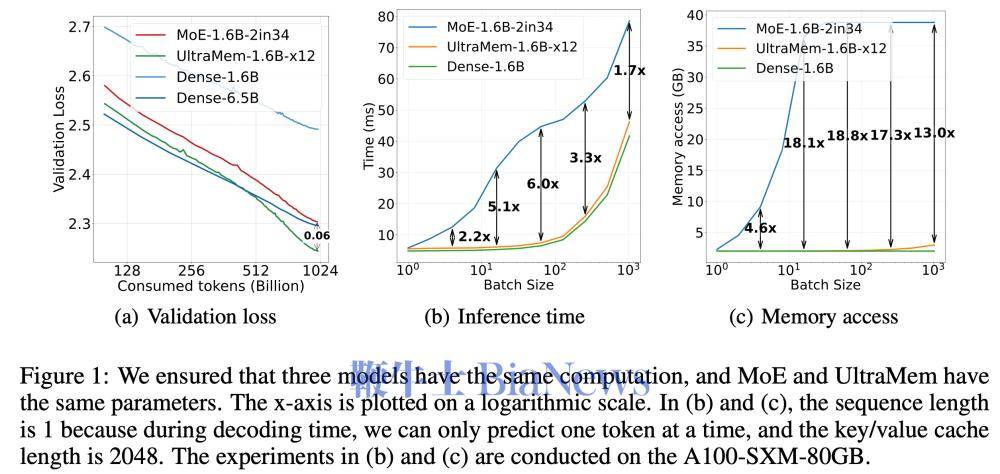

鞭牛士 2月12日消息,据豆包大模型团队消息,字节跳动豆包大模型Foundation团队近期提出UltraMem,一种同样将计算和参数解耦的稀疏模型架构,在保证模型效果的前提下解决了推理的访存问题。据介绍,该架构有效解决了MoE推理时高额的访存问题,推理速度较MoE架构提升2-6倍,推理成本最高可降低83%。

实验结果表明,训练规模达 2000 万 value 的 UltraMem 模型,在同等计算资源下可同时实现业界领先的推理速度和模型性能,为构建数十亿规模 value 或 expert 开辟了新路径。

据介绍,UltraMem 是一种同样将计算和参数解耦的稀疏模型架构,在保证模型效果的前提下解决了推理的访存问题。实验结果表明,在参数和激活条件相同的情况下,UltraMem 在模型效果上超越了 MoE,并将推理速度提升了 2-6 倍。此外,在常见 batch size 规模下,UltraMem 的访存成本几乎与同计算量的 Dense 模型相当。

京公网安备 11011402013531号

京公网安备 11011402013531号