出品 丨 搜狐汽车·

作者 丨 胡耀丹

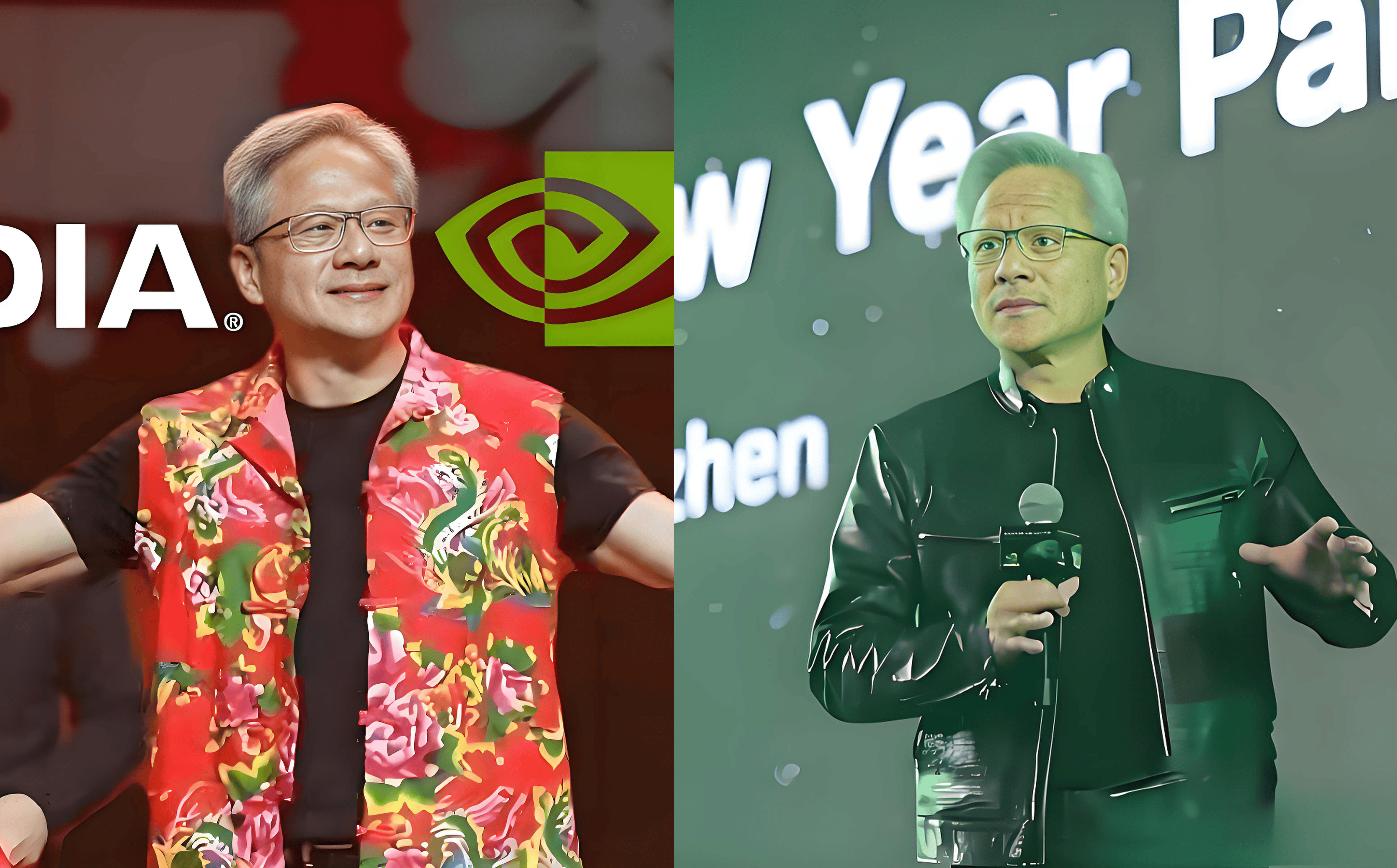

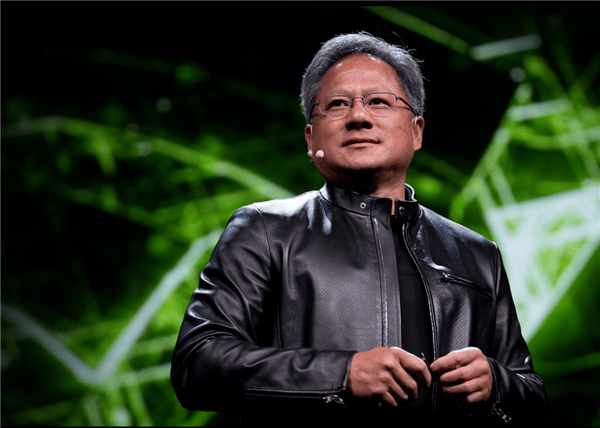

临近春节,英伟达创始人、CEO黄仁勋开启了在华“特种兵”式的行程。截止1月21日的七天时间内,黄仁勋分别到访了中国台北、深圳、北京、上海四座城市,访问理由主要是参加当地公司年会。

“AI将在未来创造出‘非凡的机遇’”在北京的“答谢迎春会”上,黄仁勋频繁使用“不可思议”“非凡”等鼓舞人心的词汇来描述AI事业,对这场AI红利的可持续性信心满满。

据悉,这场“答谢迎春会”面向外部合作伙伴、媒体、社区开发者和高校教育界人士,参与者众,较为高调,社交媒体上也有不少黄仁勋答媒体问的视频发布。而在2024年黄仁勋到访中国时,其并未在一场外界参与人士如此之多、参与者身份如此多元的“答谢迎春会” 上高调露面,并对外强调AI的美好蓝图。

实际上,在“一片大好”的AI行业形势下,AI的发展被认为正在转向。

大模型的进化正在趋缓。“这个行业(大语言模型)中的每个人都看到了收益递减。”据媒体报道,2024年年末谷歌DeepMind实验室负责人、诺贝尔奖得主、人工智能专家德米斯·哈萨比斯表示,此前工作人员通过收集大量数据训练模型,但现在科技公司已经几乎用尽这些数据。

AI红利不会消失,但会转移。在此背景下,已有大模型正在寻求更具商业化前景的落地,也就是将大模型与各个行业结合,进入应用层,而这需要定制化推理芯片的参与。

未尽研究发布的看DAO2025报告显示,大模型叙事已经发生变化,开始在当前AI芯片主战场外,开辟出第二条战线——定制推理芯片。英伟达的竞争对手,英伟达的客户,均已加入第二条战线的阵营。看DAO2025指出,训练好比实验室探索,推理类似工厂量产。此外,与训练芯片相比,定制化推理芯片的成本、供应链更可控。

而在推理芯片领域,“定制化”的要素被强化了,这并不利于以训练芯片为主打产品的英伟达。在终端产品上,这一需求正在显现。

自动驾驶被视作AI商业化落地的“先行者”,英伟达也将汽车视作未来三大支柱业务之一。目前,完全自动驾驶技术落地较为困难。今年1月,英伟达汽车业务副总裁阿里·卡尼(Ali Kani)表示,完全自动驾驶的汽车在2030年不太可能在公共道路上全面使用。

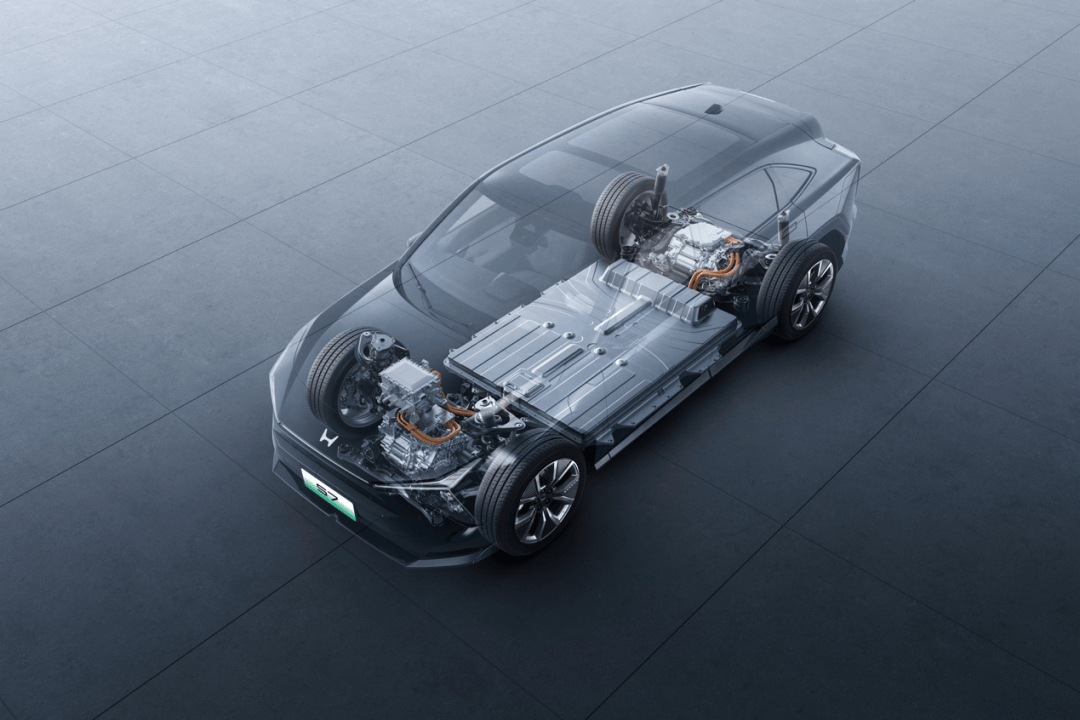

但身处智驾竞赛的中国车企,在加速拥抱定制推理芯片。专用、高效、平价等需求的推动下,特斯拉自研的FSD芯片、蔚来、小鹏选择自研智驾芯片,都已经展现出车企需求的一角。即便英伟达面向自动驾驶系统推出了Orin、Thor两款产品,但成本、专用性、功耗、供应稳定等问题仍如影随形。

01 AI红利或转移

英伟达正在面临AI红利转移的风险。最直观的表现是,在财报上,2025财年第三财季,其营收同比增速放缓。

自2024财年第一财季(2023年2月1日 - 2023年4月30日)以来,英伟达财季销售收入同比增速一直超过100%。但在2025财年第三财季,其营收虽创新高达350.82亿美元,但同比增长率降至94%,出现放缓趋势。并且,其业绩指引显示,下个财季的营收将进一步放缓。

与此同时,英伟达的股价也在起起伏伏中短暂进入“瓶颈期”。当地时间1月7日,在CES 2025黄仁勋发表主题演讲当日,其股价下跌6.22%。与此同时,叫阵英伟达的AI芯片定制公司博通却在今年1月冲破万亿美元市值大关。

英伟达因AI而兴,而其如今在财务和股价上的一系列变化,也与AI行业的发展不无关系。

2024年末,路透社、彭博社等媒体均指出,AI大模型正在遭遇训练瓶颈。据报道,AI大模型训练主要面临两道难关,一道是成本,一道是数据。

有知情人士透露,大模型的“训练运行”可能耗资数千万美元,要求同时运行数百个芯片,复杂的系统更容易导致硬件故障,研究人员可能需要等待数月才知道模型的最终表现。其次,大语言模型需要大量数据,AI模型几乎已经用尽了全球易获取的数据资源。训练运行还受到电力短缺的阻碍,因为这一过程需要巨大的能源投入。

在此背景下,将已有大模型下放到应用层,与细分市场产品结合,成为了AI大模型行业的第二阶段发展方向。

2024年下半年,微软CEO纳德拉曾直言,AI的网络效应只存在于在应用层,因此没有必要在单一模型上投太多钱。微软AI部门负责任人苏莱曼在第三届IA峰会上表示,预训练模型将被商品化,不同场景用不同的模型,未来医疗、法律和金融等领域将会有专门的模型。

在此过程中,定制推理芯片将分走一部分AI红利。

训练芯片主要用于训练大模型,帮助制造“机器”。而定制推理芯片主要使用已经训练好的模型进行推理,也就是使用“机器”来制造产品。

比如在汽车智驾领域,训练芯片主要会处理大量的数据来训练复杂的大模型。当“成品”大模型搭载到车端后,则需要推理芯片来执行预先训练好的大模型,并在车辆行驶过程中提供实时计算支持。与训练芯片相比,直接作用于应用层的推理芯片,更注重效率、快速响应和低成本、低功耗。

伴随着AI大模型进入各个细分行业,“AI+”成为主流,推理芯片的需求也应声而涨。英伟达2024财年Q4的业绩会纪要显示,公司2024财年数据中心已经有40%的收入来自推理业务。

但在英伟达的产品体系内,通用训练芯片仍是主力,并且定制能力较为薄弱。致力于帮助科技公司开发AI芯片的博通认为,博通2027年面对最高900亿美元的可及市场(SAM),增量来自定制AI芯片。到2028年,英伟达GPU在推理市场的份额预计将从目前的80%降至50%。

目前,谷歌已与博通合作开发了TPU(一种专用集成电路芯片),微软实现了“CPU+GPU+DPU”全面自研,meta发布了第二代MTIA(一种专用集成电路芯片)。

02 汽车终端演绎挑战

汽车业务是英伟达布局具身智能的一个抓手。黄仁勋曾将自动驾驶技术技术抽象为机器人、自动机器中的自动系统、半自动系统。

他表示,未来,英伟达的潜在市场规模将达到1万亿美元。具体到细分市场,汽车行业的收入将占33%,超过3000亿美元。在黄仁勋眼中,汽车业务、数据中心、游戏是英伟达的三大支柱业务,即便目前汽车业务在英伟达的营收中占比仍然较小。

因此,当AI大模型发展方向转移,AI芯片的“第二战场”开启,这一趋势快速反映到智能汽车这一终端上。而在全球智能汽车市场中,中国是领头企业最集中的市场。

“车厂将来既要做芯片,也要合作芯片。”2024年9月,在云栖大会上,小鹏汽车董事长、CEO何小鹏说,小鹏汽车的逻辑是主要芯片,如大算力、专有化的AI推理芯片考虑自己做,但是很多芯片还是和合作伙伴一起做。一些云端算力、本地端算力的芯片,需要社会化分工,用英伟达、高通等公司的产品。但在专有能力上,自研芯片能做得更强、更便宜。

这一思路的背景是,在汽车智能化演进愈发深入的当下,如何做出差异成为车企、智驾方案供应商、智舱方案供应商的难题。与通用芯片相比,定制化芯片能对算力大小、占比进行更细致的把控,能将算力真正有效使用,因此能够一定程度上帮助企业实现差异化。

何小鹏曾表示,公版芯片在实际应用中存在大量通用算力的浪费,为了匹配这一需求,小鹏汽车选择自研芯片,旨在实现更高的资源利用效率和更强的技术掌控力。而蔚来汽车董事长、CEO李斌也曾表示,蔚来研发芯片也是为了提升毛利,智能驾驶芯片的目标是用一颗自研芯片实现目前业界四颗旗舰芯片的性能,使得效率和成本更优。

同时,英伟达芯片存在供应上的不稳定,也让部分车企望而却步。比如,小鹏汽车的产品负责人曾透露,原本小鹏P7+计划使用英伟达Thor芯片,但由于芯片延期,最终选择了双Orin-X配置。

在CES 2025展会开幕首日,黄仁勋公布了英伟达在汽车领域开展合作的公司,蔚来和小鹏已经不再出现在这份名单中。

不过,英伟达的AI红利仍然存在,只是会随形势变化而有所改变。英伟达全球副总裁、汽车事业部负责人吴新宙表示,英伟达可以补车厂的一些短板,比如说其也在做大模型,可以向车厂提供大模型,也可以提供整体的全栈方案。

复制到其他可落地的产业领域内,该逻辑仍然成立。只是对英伟达来说,这份AI红利可能会不如预期。

京公网安备 11011402013531号

京公网安备 11011402013531号