12 月 29 日消息,Hugging Face、英伟达和约翰霍普金斯大学研究人员联手为 Hugging Face 上的热门编码器模型 BERT 推出了全新版本 ModernBERT,号称在满足效率的同时新增支持处理长达 8192 个 Token 的上下文。

开发团队表示,尽管 BERT 模型自 2018 年发布以来仍被业界广泛使用,并且是 Hugging Face 上下载量第二大的模型(仅次于 RoBERTa),每月下载量超 6800 万次,但这款模型如今已有些落后。

在 BERT 模型首次发布 6 年后的今天,Hugging Face 和其他团队借鉴了近年来业界 LLM 的进展,对 BERT 模型架构和训练过程进行改进,最终公布了 ModernBERT 模型以接替原版 BERT 模型。

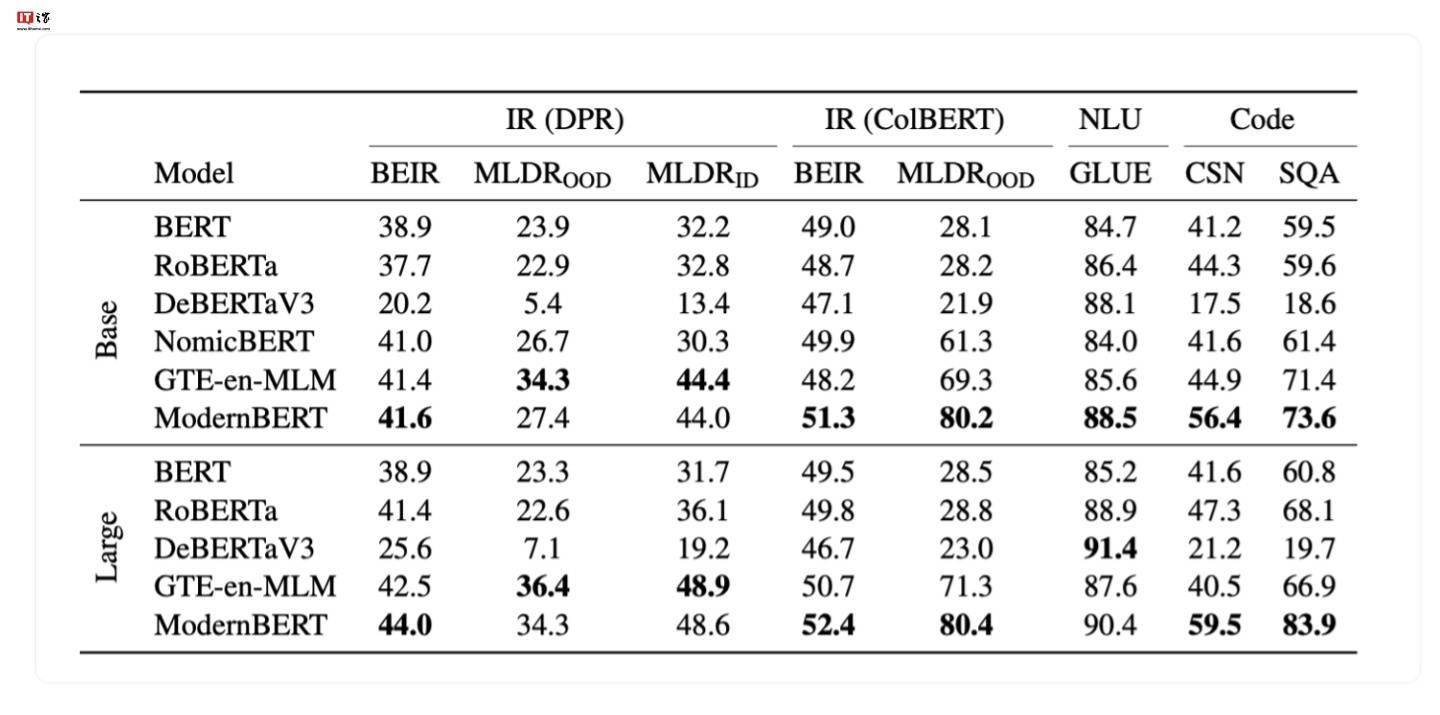

▲ ModernBERT 模型的基准测试结果

据悉,相关开发团队使用了 2 万亿个 Token 来训练 ModernBERT,使得该模型在多种分类测试和向量检索测试中都达到了目前业界领先水平,目前开发团队共计公布了两个版本的模型,分别是 1.39 亿参数和 3.95 亿参数版本,附项目地址如下(点此访问)。

京公网安备 11011402013531号

京公网安备 11011402013531号