12 月 28 日消息,谷歌 DeepMind 团队最新推出了“可微缓存增强”(Differentiable Cache Augmentation)的新方法,在不明显额外增加计算负担的情况下,可以显著提升大语言模型的推理性能。

项目背景

注:在语言处理、数学和推理领域,大型语言模型(LLMs)是解决复杂问题不可或缺的一部分。

计算技术的增强侧重于使 LLMs 能够更有效地处理数据,生成更准确且与上下文相关的响应,随着这些模型变得复杂,研究人员努力开发在固定计算预算内运行而不牺牲性能的方法。

优化 LLMs 的一大挑战是它们无法有效地跨多个任务进行推理或执行超出预训练架构的计算。

当前提高模型性能的方法涉及在任务处理期间生成中间步骤,但代价是增加延迟和计算效率低下。这种限制阻碍了他们执行复杂推理任务的能力,特别是那些需要更长的依赖关系或更高地预测准确性的任务。

项目介绍

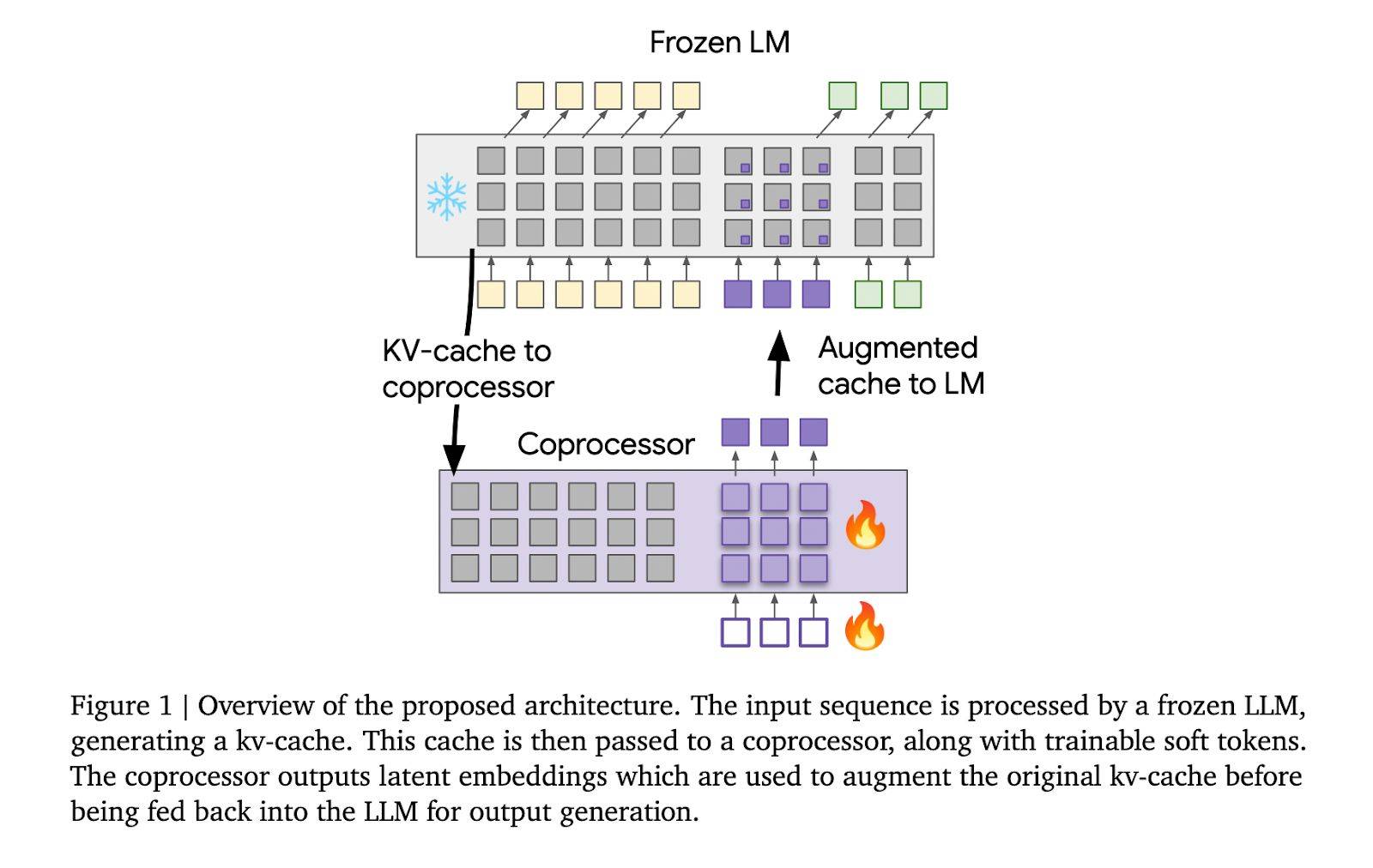

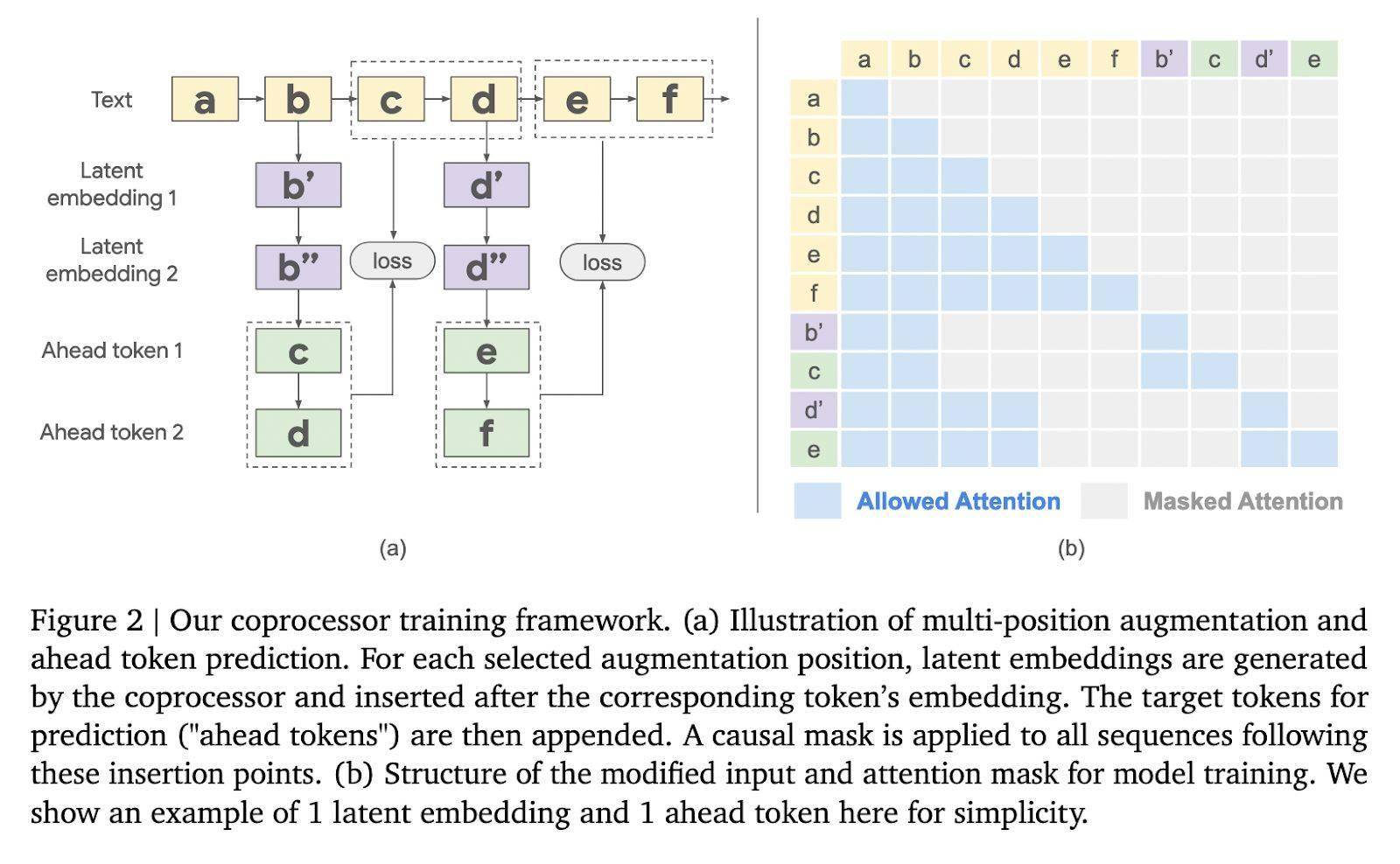

“可微缓存增强”(Differentiable Cache Augmentation)采用一个经过训练的协处理器,通过潜在嵌入来增强 LLM 的键值(kv)缓存,丰富模型的内部记忆,关键在于保持基础 LLM 冻结,同时训练异步运行的协处理器。

整个流程分为 3 个阶段,冻结的 LLM 从输入序列生成 kv 缓存;协处理器使用可训练软令牌处理 kv 缓存,生成潜在嵌入;增强的 kv 缓存反馈到 LLM,生成更丰富的输出。

在 Gemma-2 2B 模型上进行测试,该方法在多个基准测试中取得了显著成果。例如,在 GSM8K 数据集上,准确率提高了 10.05%;在 MMLU 上,性能提升了 4.70%。此外,该方法还降低了模型在多个标记位置的困惑度。

谷歌 DeepMind 的这项研究为增强 LLMs 的推理能力提供了新的思路。通过引入外部协处理器增强 kv 缓存,研究人员在保持计算效率的同时显著提高了模型性能,为 LLMs 处理更复杂的任务铺平了道路。

京公网安备 11011402013531号

京公网安备 11011402013531号