12 月 12 日消息,谷歌今天(12 月 12 日)发布博文,宣布正式向 Google Cloud 客户开放第六代 TPU Trillium,希望凭借大的计算能力、高效的性能和可持续特性,更好推动 AI 模型发展。

Trillium TPU 是 Google Cloud AI 超级计算机(AI Hypercomputer)的关键组件,是一种突破性的超级计算机架构,采用了一个由性能优化的硬件、开放软件、领先的机器学习框架和灵活的消费模型组成的集成系统。

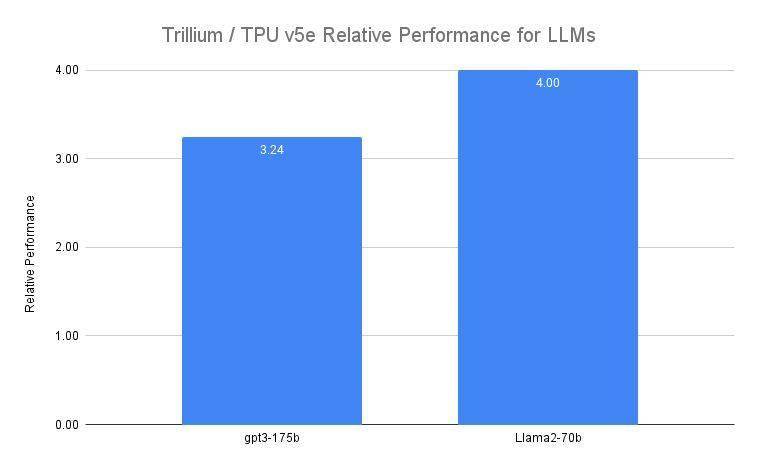

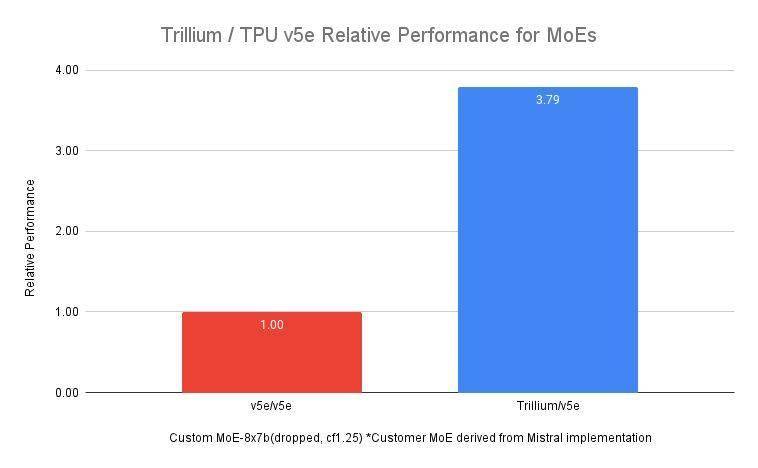

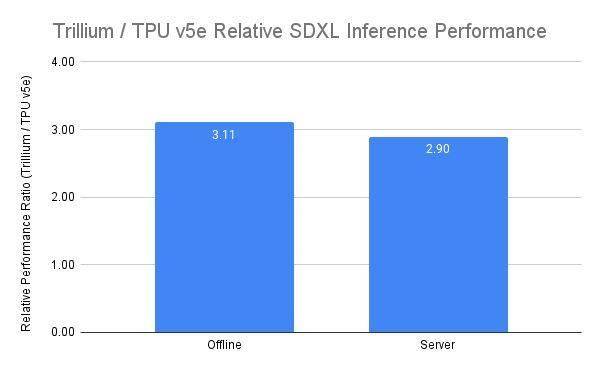

曾于今年 5 月报道,在 I/O 开发者大会上,谷歌正式宣布 Trillium TPU。官方称相比上一代,Trillium TPU 在训练性能上提升 4 倍以上,推理吞吐量提升高达 3 倍,峰值计算性能提升 4.7 倍。

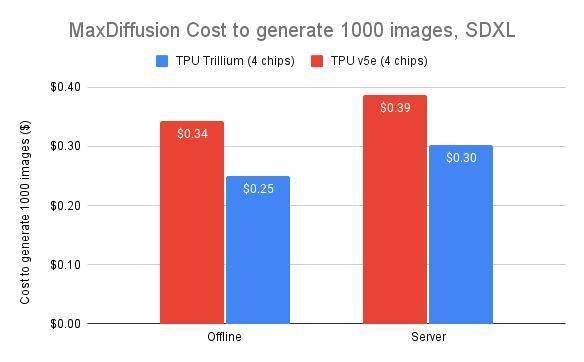

在效率方面,Trillium TPU 能源效率提高 67%,每美元训练性能提升高达 2.5 倍,推理性能提升高达 1.4 倍。

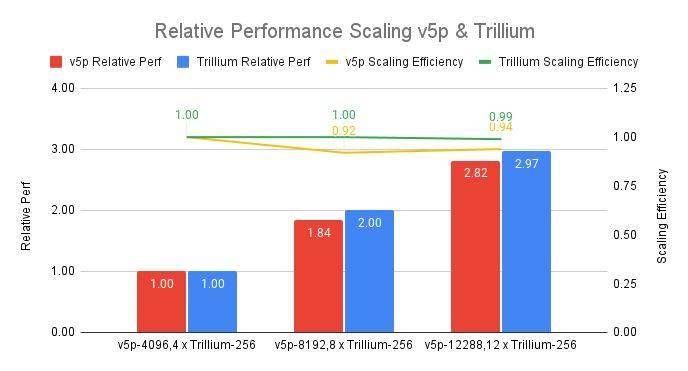

在规模扩展方面,单个 Jupiter 网络结构可容纳 10 万个 Trillium 芯片,双倍的 HBM 容量和 ICI 带宽,支持大规模 AI 训练。

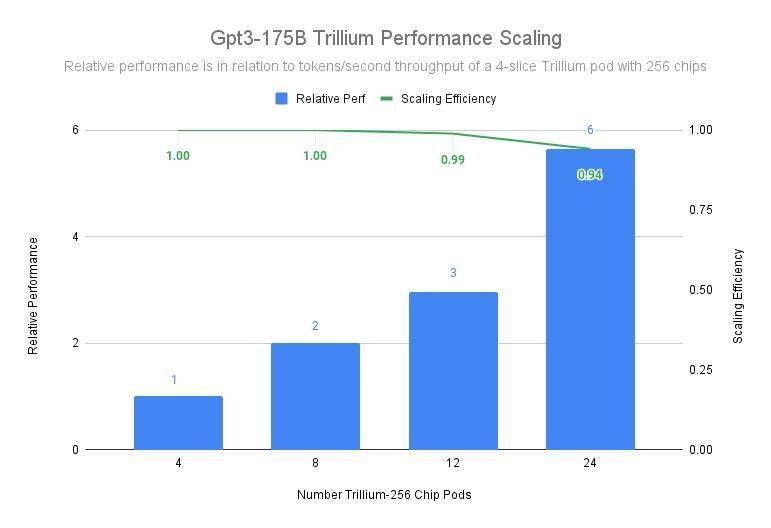

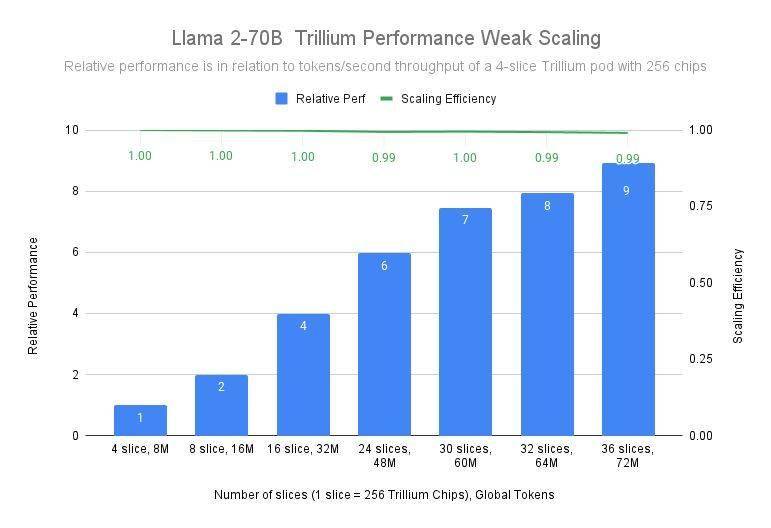

官方称 Trillium 近乎线性的扩展能力,配合高速芯片互连和 Jupiter 数据中心网络,显著加快大型模型训练速度,在训练 gpt3-175b 模型时,即使跨数据中心网络运行,24 个 Pod(6144 个芯片)也能达到 94% 的扩展效率。

京公网安备 11011402013531号

京公网安备 11011402013531号